引语:在具身智能领域,数据是智能的最重要燃料,它石智航正成为“为众人抱薪者”。

12 月 26 日,它石智航重磅开源了全球首个大规模真实世界具身 VLTA(Vision-Language-Tactile-Action)多模态数据集 ——World In Your Hands(简称 “WIYH 数据集”)。该数据集首次亮相于今年 10 月,并在刚刚结束的它石智航技术首秀发布上,作为「超级算法」中的核心成果之一得到行业广泛认可。首秀现场展示的世界首台可人工刺绣机器人等成果,其丝滑动作背后的核心正是基于 WIYH 数据集训练的AWE2.0模型。

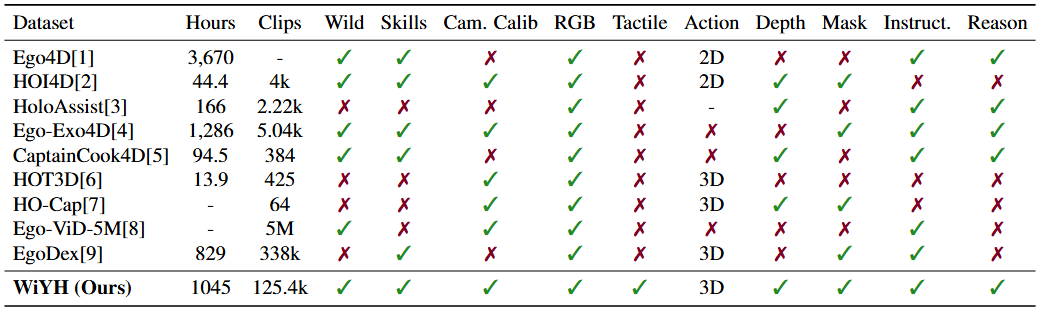

WIYH 数据集通过首创 “Human-centric”(以人为中心)的数据采集新范式,破解了遥操作数据采集规模化成本高、仿真数据在 sim2real 时存在 GAP,难以丝滑迁移到现实世界的痛点,填补了具身智能所需的高质量、可泛化、大规模真实世界数据的空白,为具身基座模型实现 Scaling Law 提供了关键语料。要知道,当前具身智能所需数据量与现有储备之间至少相差两个数量级,WIYH的开源正为填补这一鸿沟提供了核心解法,加速了具身智能落地真实世界的进程。

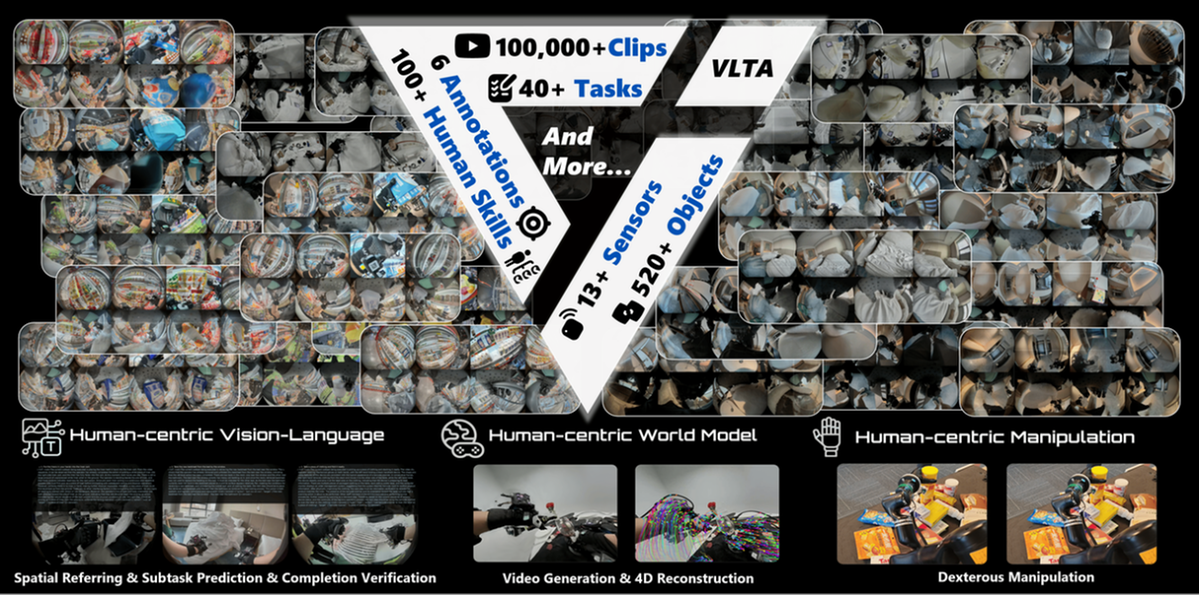

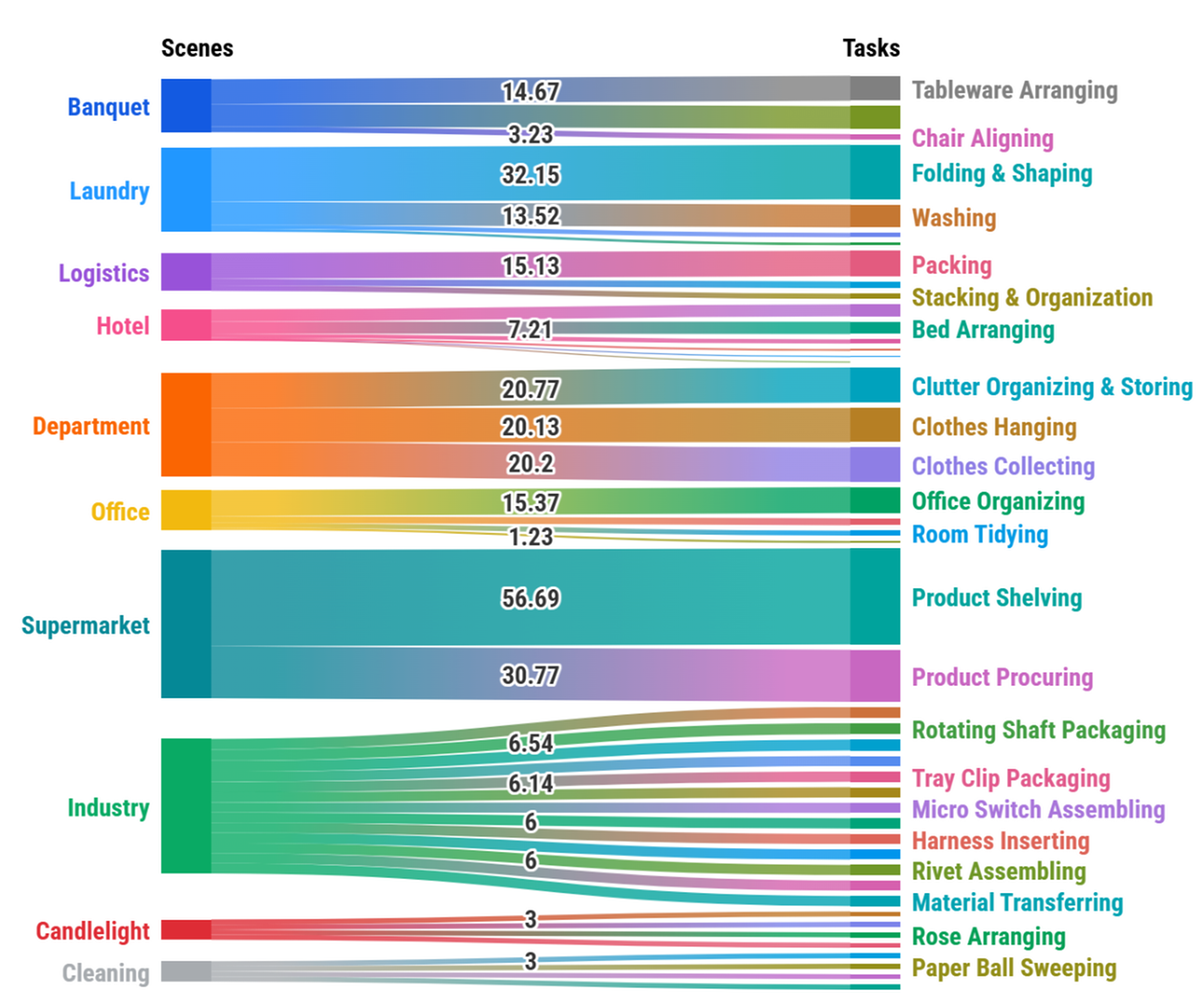

在 Human-centric 采集范式下形成的 WIYH 数据集,具备了真实可靠、丰富多元、全面多模态、规模化等特征,并拥有海量数据:包含超过10万条以上的真实人类操作视频、40余种任务类型、100多种人类技能,覆盖了含520 余种真实物品,真实还原商超、酒店、餐饮、工业、办公、家居等多行业的10种核心场景全链路任务,数据将分批次释放。WIYH是业内最大的Human-centric数据集,且仍在不断扩展和丰富中。

场景和任务分布

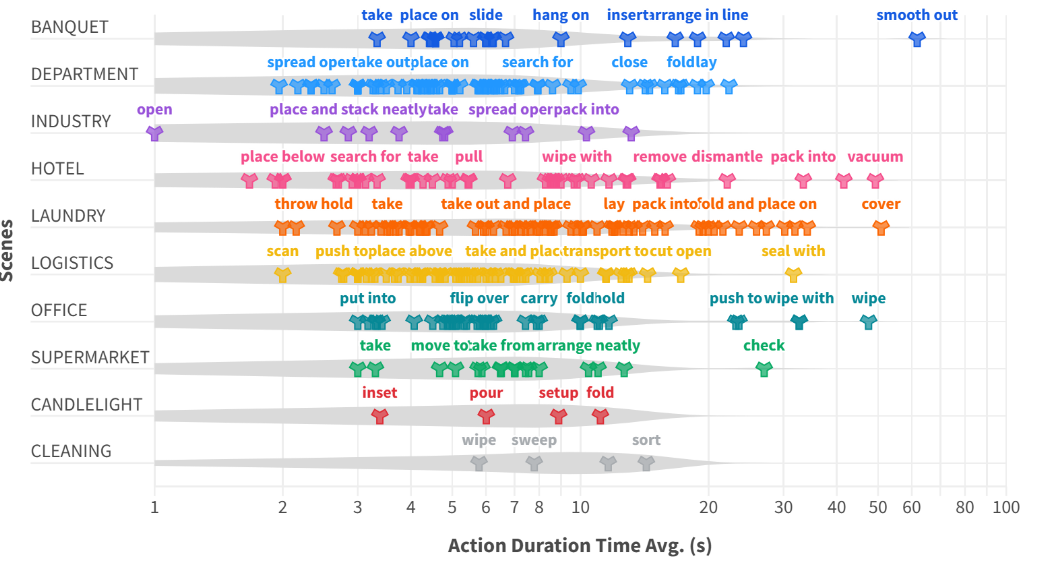

各场景技能分布

物体和技能词云

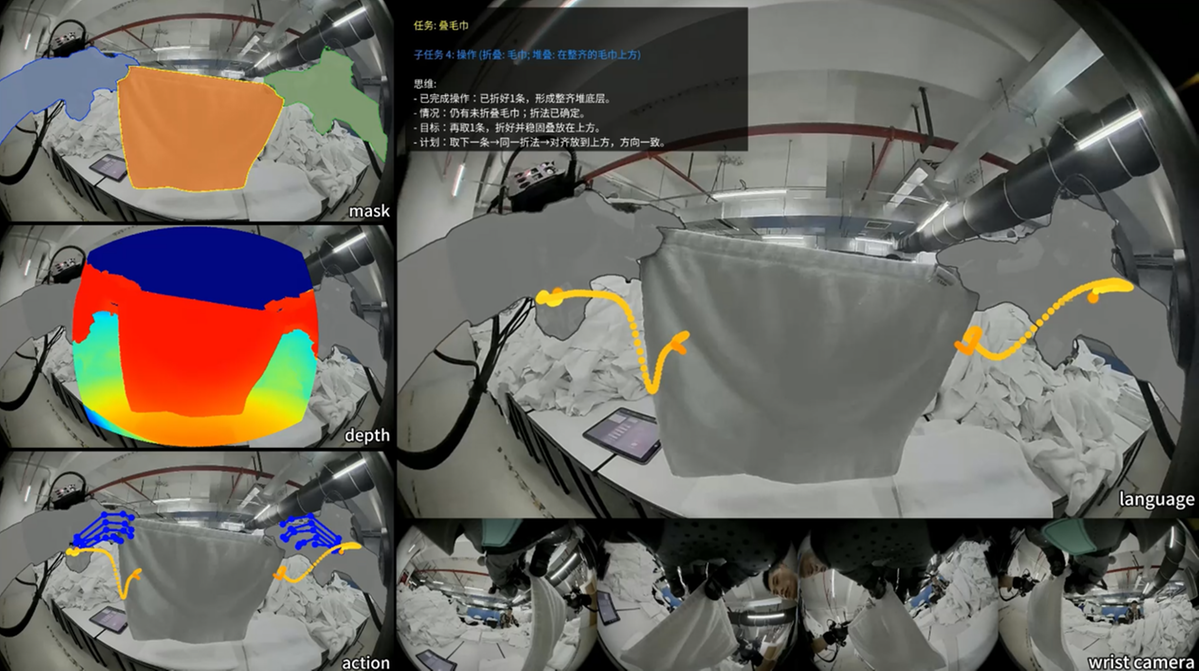

采集了丰富的数据之后,行业还面临数据迁移这另一核心难题,为此它石构建了 TARS Datacore 具身数据引擎。作为云端大模型,它实现了全流程的自动化标注,将原始视频转化为机器人能理解的“教科书”。这套标注体系不仅涵盖了标定、深度、动作、指令、思维链 (COT)、掩码(Mask)和触觉(Tactile)等基础信息,更通过以下三类精准标注,形成了从感知到动作的全链路闭环:

它石首席科学家丁文超博士表示,“Human-centric数据采集范式配合TARS Datacore数据引擎,可以记录和生产最高质量、最丰富的具身智能数据,真正使得scaling law成为可能。”

强大的数据采集与迁移能力,共同打磨出 WIYH 数据集在空间推理、世界模型、跨本体迁移等方面的独特优势。目前,多项基准测试结果已印证了 WIYH 数据集的核心价值:

它石创始人兼 CEO 陈亦伦博士认为,“在 AI 领域,最极致的开放不是开源模型,而是开源数据集,因为所有的 AI 模型本质上都可以通过数据和合适的训练方法‘生长’出来。” 它石WIYH的此番开源,正是以开放的态度,为行业通用具身基座模型训练提供关键语料和基础设施,助力具身智能迈向通用智能的新高峰。

它石WIYH数据集于今日起(12.26)可正式访问。该网站构建了从认知到实践的全方位支撑:用户既能通过结构化的数据集全景展示、基准测试结果与典型用例,快速完成对数据集性能与场景的初步了解,又能配合快速入门指南与自动化 SDK,直接进入深度的落地实践与开发部署。网站公布了标准化的 off-the-shelf (OTS) 开源可复现方案,也放出了 TARS商用级Human-centric数据解决方案TARS SenseHub的相关信息。 TARS SenseHub 是由它石自研的超轻量数据采集套件,包含 “眼睛” TARS-Vision 与 “双手” TARS-Glove 两大关键组件。其核心理念是让人类和机器共享同一套感知体系,即机器人通过数据“能看人之所看,感人之所感”。

未来,它石智航将继续坚持以人为中心的具身数据与模型新范式,持续挖掘真实世界的数据价值,让面向万物、赋能万业的具身智能真正从实验室走进千家万户。

(图片由它石智航授权提供)

以上内容为推广信息,所涉及内容不代表本网观点,不构成投资建议、消费建议。